Au-delà de Atlassian Intelligence, est-il possible d’exploiter les possibilités de l’IA avec les versions Data Center des solutions Atlassian ?

Dans un précédent article, nous avons pu découvrir les nouvelles fonctionnalités basées sur l’IA proposées par Atlassian dans ses solutions Cloud. L’intégration de l’Intelligence Artificielle (IA) représente pour l’éditeur plus qu’une simple évolution technique. Atlassian voit dans l’IA une opportunité de valorisation de son activité et de contribution à son objectif : unleash the potential of all teams.

Or, au cours des dernières années, l’éditeur a décidé que les solutions sur site (On Premise ou Self-Managed) étaient moins valorisables que leurs équivalents Cloud. Il a donc engagé leur abandon progressif (version Server) ou leur dé-priorisation (Data Center). Dans cette logique, et à cause de la complexité technologique, les équipes d’Atlassian ont développé toutes les possibilités offertes par l’IA exclusivement pour le Cloud. Ils n’ont donc pas envisagé de solutions pour le Data Center.

Cependant, rien ne nous empêche d’explorer les possibilités de l’IA pour les versions Data Center !

Mise en place d’un chatbot dopé à l’IA sur un Data Center Atlassian

Plaçons-nous au sein d’une équipe de support informatique qui traite de nombreux tickets à l’aide de Jira Service Management. Celle-ci a déjà mise en place plusieurs actions pour gérer efficacement les tâches simples et répétitives :

- Configuration du portail pour amener l’utilisateur à fournir de manière standardisée toutes les informations nécessaires au bon traitement de sa demande,

- Création d’une base de connaissance avec des articles à jour, courts, précis et spécifiques aux problématiques les plus courantes,

- Configuration d’automations et de workflows efficaces pour l’assignation et le traitement des demandes.

Malgré cela, chaque jour, un volume non négligeable de demandes de niveau 1 continue d’être créé via le portail. L’étape suivante, dans la quête qui vise à amener les utilisateurs à résoudre eux-mêmes leurs problèmes (Shift Left), pourrait donc être la mise en place d’un robot conversationnel basé sur l’IA générative. Les bénéfices seraient de permettre aux utilisateurs d’obtenir une assistance instantanée et donc de réduire la charge de travail des agents du support informatique.

Chatbot : une solution d’IA sur le Data Center Atlassian

Comment implémenter cela sur une instance Jira Service Management en Data Center ? Actuellement, plusieurs solutions sont envisageables :

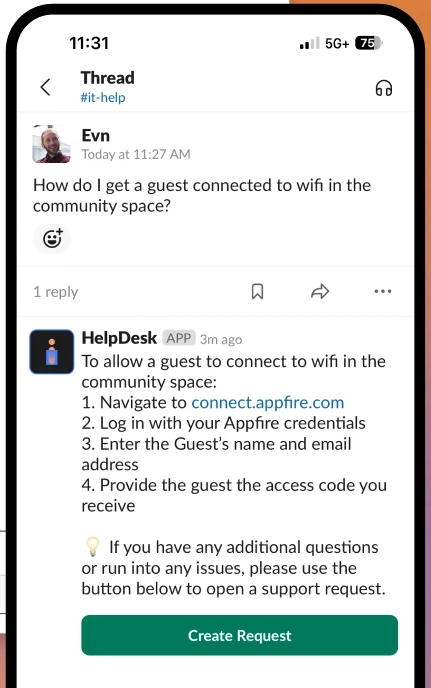

- Le plugin d’Appfire, HelpDesk+ AI-Powered Slack Support, disponible sur la marketplace d’Atlassian. Le plugin propose un chatbot intégré dans Slack. Les réponses sont basées sur les articles de la base de connaissance Confluence liée au portail. On retrouve le même principe qu’avec Atlassian Intelligence.

- Un chatbot qui permet aux utilisateurs d’obtenir des réponses. Soit via une interface web, soit dans des outils de messagerie (Teams, Slack, etc.) ou qui se base sur des données internes (Confluence ou autres sources internes). Certaines solutions (Wikit, Workativ, Responsa) permettent aussi de s’interfacer avec Jira Service Managament via ses API. Cela permet de passer le relais aux équipes de support et d’aider à la création de tickets lorsque les limites de l’agent virtuel sont atteintes.

- Un développement spécifique qui vient intégrer la base de données de Confluence comme contexte à la requête d’un utilisateur à une IA. Par exemple, il est possible d’envisager de développer une interface qui ajoute en contexte de la requête à destination d’un IA comme Chat-GPT le contenu de la page Confluence la plus similaire à la question [Source].

Cependant, au-delà de l’implémentation technique qui passe par des solutions tiers, il faut garder en tête que pour être en mesure de délivrer ses réponses, un agent virtuel doit s’appuyer sur une base de connaissance étayée, structurée et maintenue à jour (Garbage in, Garbage out). De plus, il y a un travail sur la conception de l’arborescence du dialogue, du schéma d’échanges et d’escalade qui demande une implication initiale importante de l’équipe support. En bref, il vaut mieux réaliser une étude d’opportunité en amont.

Génération automatique de documentation : architecture RAG

On peut utiliser l’IA générative pour générer automatiquement des documents à partir de données et d’informations pertinentes au contexte de l’entreprise. Il est possible pour cela d’utiliser une architecture RAG (Retrieval Augmented Generation). Elle va venir diriger un modèle de langage volumineux (LLM) afin de limiter l’IA générative au contenu d’entreprise. Il est donc tentant de vouloir créer le contenu d’une base de connaissance afin de proposer des solutions pour les équipes de support en entraînant une IA sur des données internes spécifiques. Pour cela, les étapes seraient théoriquement :

- Identifier et collecter les données internes ou externes relatives aux missions de l’équipe de support qui serviront à alimenter l’IA. Par exemple :

- les manuels d’utilisation ou release notes d’applications internes

- le résultat de webscrapping de sources pertinentes

- Processer les données pour qu’elles soient au format utilisable (base de données vectorielle)

- Choisir une IA Générative et l’entrainer sur les données choisies

- Interroger l’IA sur les problématiques récurrentes rencontrées par les utilisateurs

- Intégrer les réponses dans Confluence (création de pages automatique via les API par exemple)

Dans la pratique, mettre en place une architecture RAG n’est pas une action évidente. Cela demande de transformer les données pour les rassembler dans une base de données vectorielle robuste. La difficulté de cette démarche repose aussi sur la qualité des données à disposition. L’IA générative ne fera que mettre en forme, synthétiser et restituer de l’information. Dans le meilleur des cas, un travail pointilleux de relecture devra être mené. Il sera en effet nécessaire de s’assurer de l’exactitude et de la pertinence des réponses générées.

L’IA générative pour l’assistance au développement logiciel

Entre Bitbucket et GitHub, deux des principaux dépôts de code du marché, l’écart risque de se creuser avec l’arrivée de Copilot.

Qu’est-ce que Copilot ? C’est un outil de complétion de code, alimenté par l’IA, et proposé par Microsoft. Copilot a pour ambition de révolutionner la façon dont les développeurs travaillent grâce à la suggestion de code en temps réel.

Ces suggestions sont basées sur des modèles de code testés et largement utilisés. Elles permettent d’améliorer la qualité et la fiabilité du code. Les développeurs peuvent, en observant les suggestions de Copilot, apprendre de nouvelles techniques, modèles et pratiques de code.

Les promesses sont impressionnantes. La réalité un est un peu en deçà des attentes car plusieurs problématiques émergent.

Un exemple parmi d’autres, les suggestions vont souvent dans le sens de la génération de code. Elles ne proposent que rarement des mises à jour ou de la suppression de code. Cela tend à produire une quantité importante de code redondant [Source].

Copilot est normalement intégré à GitHub. On peut toutefois l’utiliser avec Bitbucket en suivant quelques étapes via l’extension Copilot dans Visual Studio Code, par exemple [Source]. Il existe aussi plusieurs plugins disponibles dans la marketplace d’Atlassian pour les versions Cloud et Data Center de Bitbucket qui proposent des fonctionnalités similaires [Source].

Pour conclure

L’exploration des possibilités offertes par l’IA pour les solutions Data Center d’Atlassian devient assez rapidement frustrante. Le décalage est grand entre les envies et les possibilités existantes.

Comment procéder pour avoir une IA à qui l’on pourrait poser des questions en langage naturel sur l’ensemble des données d’une instance Jira Data Center ?

Je n’ai pas trouvé de réponse tant les défis sont nombreux. Je pense aux formats des données en base, rafraîchissement des données, choix de l’architecture à mettre en place pour l’IA, etc ….

Nous resterons donc sur un sentiment d’insatisfaction… Qui pourra changer rapidement tant l’évolution de l’environnement technologique de l’intelligence Artificielle se transforme rapidement.

PS : cet article n’a pas été généré par une IA. Il a bien été écrit par un collaborateur de SmartView fait de chair et d’os !

Retrouvez nos articles sur notre série consacrée à l’IA (intelligence artificielle) :

Qu’attendre de l’IA pour la DSI en 2024 ?

Atlassian Intelligence, les fonctionnalités